随着人工智能与自动化技术的深度融合,在通信与自动控制技术的研究中,利用深度学习框架(如TensorFlow)进行高效计算已成为关键。为提升研究效率,在服务器上配置TensorFlow GPU版,构建高性能计算环境,显得尤为重要。本文将系统阐述服务器上TensorFlow GPU版的配置流程,并探讨其在通信与自动控制技术研究服务中的应用潜力。

一、硬件与软件环境准备

服务器的硬件配置是基础。需确保服务器配备有支持CUDA的NVIDIA GPU(如Tesla、RTX系列)、足够的内存(建议32GB以上)以及高速存储(如SSD)。软件层面,需安装合适的操作系统(推荐Ubuntu 18.04/20.04 LTS)、NVIDIA显卡驱动、CUDA工具包和cuDNN库。例如,对于TensorFlow 2.x版本,通常需要CUDA 11.x和cuDNN 8.x。配置时,应严格遵循版本兼容性,以避免依赖冲突。

二、TensorFlow GPU版配置步骤

- 安装NVIDIA驱动与CUDA:通过官方源或命令行安装驱动,并下载CUDA安装包执行配置。需设置环境变量(如PATH和LDLIBRARYPATH)以指向CUDA目录。

- 安装cuDNN:从NVIDIA开发者网站下载对应版本的cuDNN,解压后复制文件至CUDA安装路径。

- 创建虚拟环境:使用conda或venv创建独立的Python环境,推荐Python 3.8-3.10版本。

- 安装TensorFlow GPU版:在虚拟环境中,通过pip命令安装(如

pip install tensorflow-gpu或直接pip install tensorflow,因新版已整合GPU支持)。安装后可通过运行Python代码import tensorflow as tf; print(tf.config.list<em>physical</em>devices('GPU'))验证GPU是否被识别。

三、通信与自动控制技术研究服务的应用

在配置完成后,TensorFlow GPU版可大幅加速研究任务。例如:

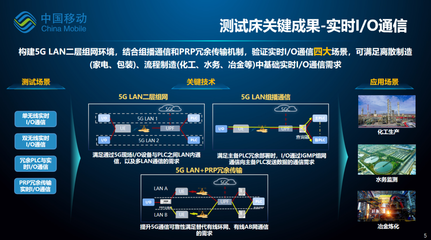

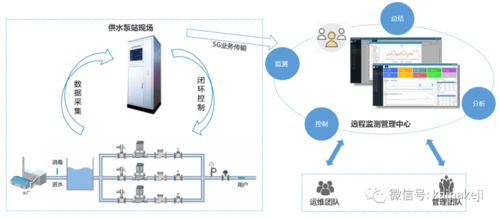

- 通信技术研究:利用深度学习进行信道估计、信号检测或网络优化。GPU并行计算能快速处理大规模通信数据,提升模型训练效率,适用于5G/6G智能通信系统的仿真与测试。

- 自动控制技术研究:在机器人控制、工业自动化或智能驾驶领域,TensorFlow可用于强化学习模型的训练,实现实时决策与控制策略优化。GPU加速能缩短训练周期,支持更复杂的控制算法验证。

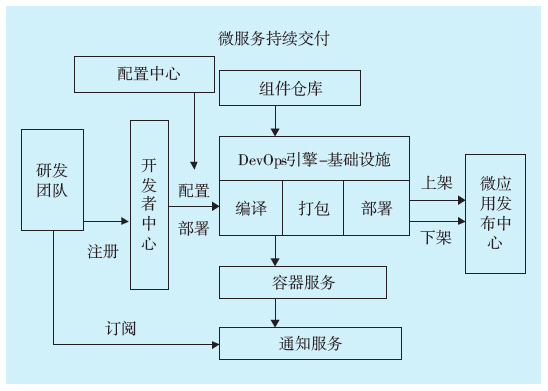

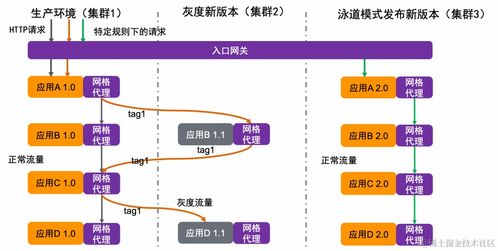

可结合Docker容器化技术,将配置好的环境封装为服务,便于团队协作和部署。通过REST API或gRPC接口,可构建研究服务平台,提供远程模型训练与推理服务,推动通信与自动控制技术的创新。

四、配置常见问题与优化建议

在配置过程中,可能遇到驱动冲突、CUDA版本不匹配或内存不足等问题。建议定期更新驱动和库,监控GPU使用情况(如使用nvidia-smi工具),并优化代码以充分利用GPU资源。例如,使用TensorFlow的分布式训练策略,可扩展至多GPU环境,进一步提升研究服务的吞吐量。

服务器上配置TensorFlow GPU版为通信与自动控制技术研究提供了强大算力支撑。通过精心部署和优化,研究人员可更高效地探索智能算法,加速技术从理论到实践的转化。